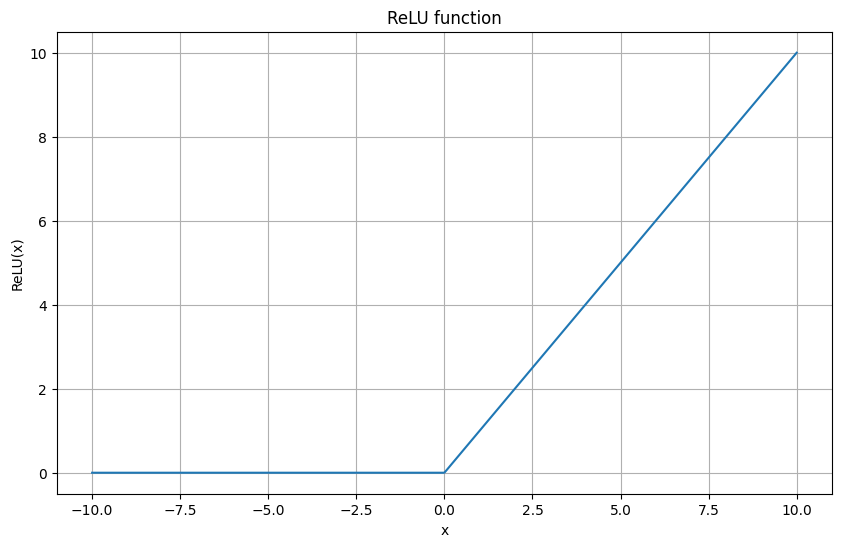

ReLU関数(Rectified Linear Unit)

これは、入力値が0以上の場合はそのままの値を出力し、0以下の場合は0を出力するという単純な関数です。ReLU関数のこの特性が、ニューラルネットワークの訓練を助ける数多くの利点を生み出します。

- スパース性: ReLUは負の領域で0を出力するため、ニューラルネットワークにおけるアクティベーションのスパース性(一部のニューロンだけが活性化する現象)を生み出すことができます。これは、ネットワークが自然界のパターンをより効率的に学習するのに役立ちます。

- 勾配消失問題の緩和: ReLUは正の領域で勾配が1であるため、深いネットワークを訓練する際の勾配消失問題を軽減するのに役立ちます。

- 計算効率: ReLUはその計算が単純であるため、シグモイド関数や双曲線正接関数などの他の活性化関数に比べて計算が高速です。

ReLUはその性質から、特に深層学習モデルにおける隠れ層の活性化関数として広く利用されています。ただし、ReLUには「死んだニューロン」の問題があります。これは、訓練中にあるニューロンが一度でも0以下の値で活性化すると、その後そのニューロンが再び活性化することがなくなってしまう現象を指します。

この問題を緩和するために、ReLUの改良版であるLeaky ReLUやParametric ReLU、そしてExponential Linear Unit (ELU) などの変種が提案されています。これらの関数は、負の領域でも微小な勾配を持つことで「死んだニューロン」の問題を防ぎつつ、ReLUの主要な利点を維持しています。

ReLU関数のグラフ

ReLU関数のグラフは以下のようなコードで実装することができます。

import numpy as np

import matplotlib.pyplot as plt

# ReLU関数

def relu(x):

return np.maximum(0, x)

# -10から10までの値を生成

x = np.linspace(-10, 10, 1000)

# y値を計算

y = relu(x)

# 図を生成

plt.figure(figsize=(10, 6))

plt.plot(x, y)

plt.title('ReLU function')

plt.xlabel('x')

plt.ylabel('ReLU(x)')

plt.grid(True)

plt.show()